IA génératives : forces et faiblesses des outils les plus utilisés

Le paysage des IA génératives a connu une accélération sans précédent entre 2024 et 2026. Claude 4, GPT-5, Gemini 2, Llama 4, Mistral Large 2 : chaque trimestre apporte une nouvelle génération de modèles qui redéfinit les standards de performance. Pour les équipes de développement, la question n'est plus de savoir s'il faut utiliser l'IA, mais comment orchestrer ces outils pour maximiser la productivité sans créer de dépendance ni de risque. Cet article fait le point sur les forces et faiblesses de chaque outil majeur en 2026, du choix quotidien jusqu'aux décisions d'architecture.

Le paysage 2026 : une concurrence féroce et des spécialisations marquées

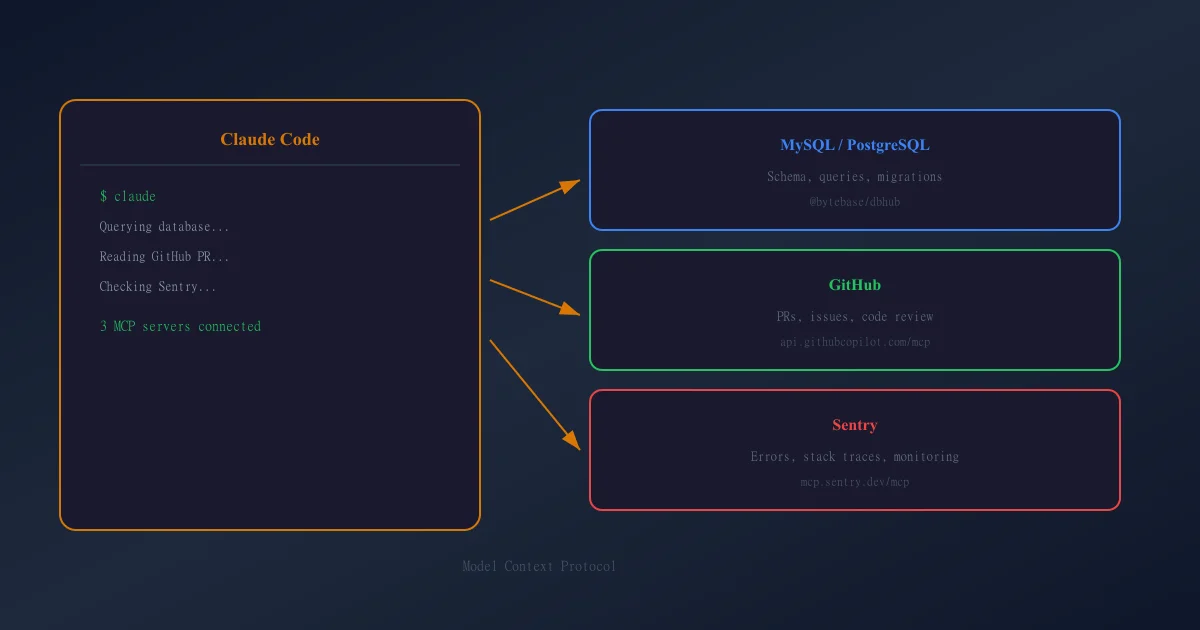

La distinction structurante pour un développeur reste celle entre les modèles conversationnels (ChatGPT, Claude, Gemini), les moteurs de recherche augmentés (Perplexity), les assistants intégrés au code (GitHub Copilot, Cursor, Claude Code) et les modèles open source déployables localement (Llama, Mistral, DeepSeek). Mais en 2026, les frontières entre ces catégories se sont brouillées. Claude Code transforme un modèle conversationnel en agent de développement. Copilot intègre des capacités de raisonnement avancées. Perplexity génère du code en plus de sourcer ses réponses.

Claude 4 d'Anthropic

Claude 4, sorti courant 2025, a marqué un tournant. Sa fenêtre de contexte étendue lui permet de travailler sur des codebases entières sans perdre le fil. Le modèle excelle sur le refactoring de projets complexes, la revue d'architecture multi-fichiers et le suivi d'instructions structurées comme celles d'un fichier CLAUDE.md. Claude Code, l'agent en ligne de commande d'Anthropic, a transformé la manière de travailler avec un LLM : au lieu de copier-coller du code dans un chat, le développeur donne des instructions et Claude modifie directement les fichiers du projet. La capacité de Claude 4 à maintenir la cohérence sur des tâches longues et multi-étapes le place en tête sur les workflows d'ingénierie. En contrepartie, le modèle reste parfois trop prudent sur les choix techniques tranchés, une conséquence de l'approche Constitutional AI d'Anthropic.

GPT-5 d'OpenAI

GPT-5, annoncé fin 2025, a consolidé la position d'OpenAI comme acteur dominant du grand public. Le modèle intègre nativement les capacités de raisonnement qui étaient auparavant réservées aux modèles o1 et o3. La chaîne de pensée est devenue transparente : le développeur peut observer le raisonnement du modèle et intervenir pour le corriger. L'écosystème de plugins et de GPTs personnalisés reste un avantage fort pour les usages métier. En revanche, OpenAI facture désormais un premium pour les capacités de raisonnement avancé, et la latence sur les requêtes complexes peut freiner l'intégration dans des pipelines automatisés.

Gemini 2 de Google

Gemini 2 a corrigé les faiblesses de la première génération. La fiabilité des réponses s'est nettement améliorée, et l'intégration avec l'écosystème Google (Workspace, GCP, Android Studio) en fait un choix naturel pour les équipes déjà investies dans cette stack. Sa fenêtre de contexte massive et ses capacités multimodales (code, texte, images, vidéo) ouvrent des cas d'usage que les autres modèles ne couvrent pas aussi bien, notamment l'analyse de maquettes UI pour générer du code frontend. Le point faible reste un écosystème développeur moins mature que celui d'OpenAI ou d'Anthropic.

Perplexity

Perplexity a évolué au-delà du simple moteur de recherche sourcé. En 2026, il combine recherche temps réel, synthèse documentaire et génération de code, le tout avec des citations vérifiables. Pour la veille technologique, la résolution de bugs obscurs ou la comparaison de librairies comme les bundles les plus utilisés dans les projets Symfony, sa traçabilité reste un avantage significatif. Mais pour la génération de code complexe ou le refactoring, il n'atteint pas le niveau des modèles spécialisés.

Les modèles open source : Llama 4, Mistral Large 2, DeepSeek V3

L'open source a rattrapé son retard. Llama 4 de Meta et Mistral Large 2 rivalisent avec les modèles propriétaires sur de nombreux benchmarks. DeepSeek V3, malgré les questions de souveraineté liées à son hébergement chinois, a démontré des performances remarquables sur le code et le raisonnement mathématique. Pour les organisations qui ont les compétences infra pour les déployer, ces modèles éliminent le coût par requête et garantissent la souveraineté des données. Le compromis : une charge opérationnelle non négligeable pour le fine-tuning, la mise à jour et le monitoring, qui nécessite des compétences solides en Cloud et DevOps.

Assistants de code : l'ère des agents

Le segment des assistants de code a connu la transformation la plus radicale entre 2024 et 2026. On est passé de l'autocomplétion intelligente à de véritables agents capables de raisonner sur un projet entier.

Claude Code

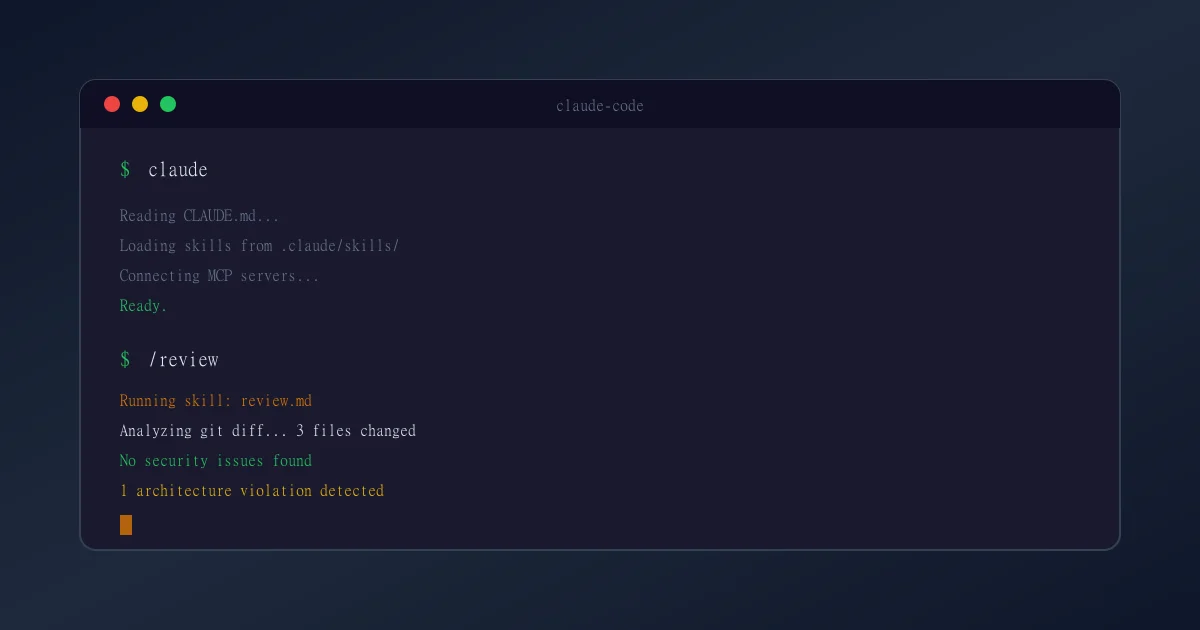

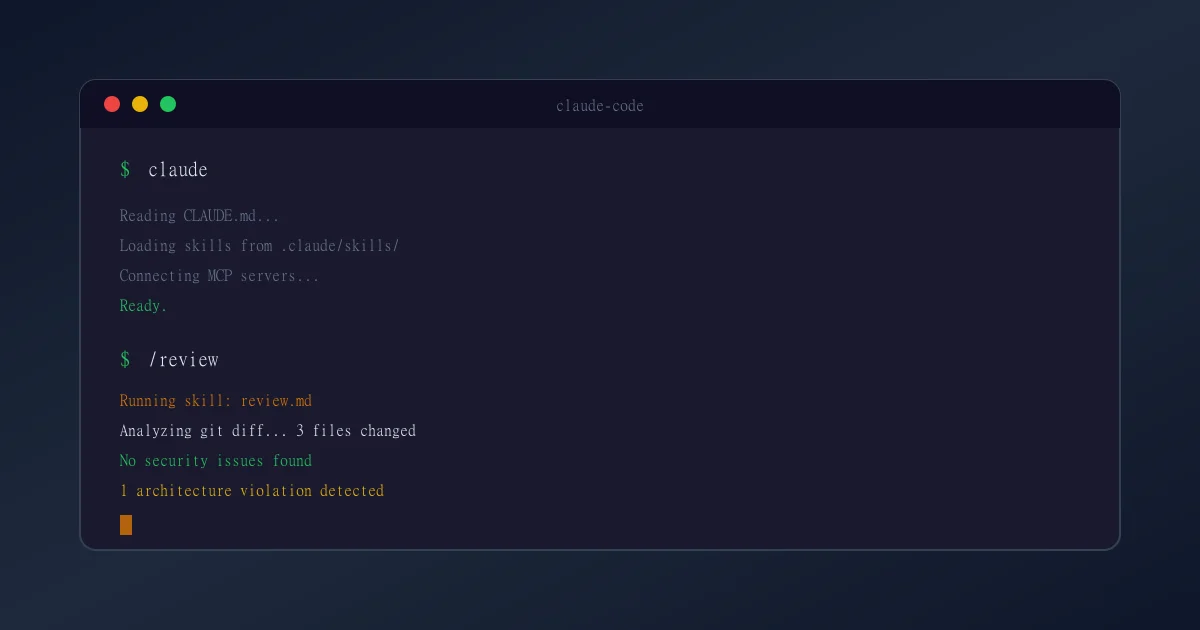

Claude Code a redéfini ce qu'un assistant de développement peut faire. En tant qu'agent en ligne de commande, il lit le code source, exécute des commandes, modifie des fichiers, lance des tests et itère jusqu'à obtenir un résultat qui passe la CI. L'intégration avec un fichier CLAUDE.md permet d'encoder les conventions d'architecture, les règles de nommage et les patterns spécifiques au projet. Sur nos projets Symfony, cette approche a réduit de 60% le temps passé sur les tâches de refactoring répétitives, en combinaison avec des outils comme Rector pour automatiser l'évolution du code. Notre retour d'expérience sur l'utilisation de Claude comme assistant d'architecture Symfony legacy illustre concrètement comment configurer cet agent pour un projet existant, et notre guide de montée en compétence Claude Code couvre les skills, hooks et serveurs MCP pour aller plus loin.

GitHub Copilot

Copilot a évolué bien au-delà de l'autocomplétion. Le mode agent, lancé courant 2025, permet de décrire une tâche en langage naturel et de laisser Copilot modifier plusieurs fichiers, créer des tests et ouvrir une pull request. L'intégration native dans VS Code et l'écosystème GitHub reste son avantage principal. Pour les équipes qui vivent dans GitHub, la friction d'adoption est minimale. Le point faible : Copilot manque encore de finesse sur les projets avec des conventions d'architecture strictes.

Cursor

Cursor s'est imposé comme l'IDE de référence pour le développement assisté par IA. Son approche "code-aware" lui permet d'indexer un projet entier et de proposer des modifications contextuelles. La possibilité de choisir le modèle sous-jacent (Claude, GPT, Gemini) offre une flexibilité que les autres outils n'ont pas. En revanche, le verrouillage dans un IDE spécifique peut freiner les équipes habituées à leurs outils.

Intégration dans les workflows : les pratiques qui fonctionnent

Un développeur confirmé ne se contente pas de poser des questions à un chatbot. L'enjeu est d'intégrer ces outils dans un pipeline de travail reproductible.

Prompt engineering : toujours pertinent, mais différent

Avec les modèles 2026, le prompt engineering a évolué. Les modèles comprennent mieux les intentions implicites, ce qui réduit le besoin de prompts ultra-structurés pour les tâches simples. En revanche, pour les tâches complexes, la structuration reste essentielle. Un prompt efficace pour du code inclut le contexte du projet (framework, version, conventions), le résultat attendu avec des critères de validation, et les contraintes explicites. La nouveauté : les fichiers de configuration comme CLAUDE.md ou les instructions système de Copilot remplacent avantageusement la répétition manuelle du contexte à chaque prompt.

Segmenter ses usages par outil

Utiliser un seul outil pour tout reste une erreur courante. La segmentation optimale en 2026 : Claude Code pour le refactoring, les revues d'architecture et les tâches multi-fichiers. Copilot ou Cursor pour l'autocomplétion quotidienne et le flux de développement continu. Perplexity pour la recherche documentaire et la veille. GPT-5 pour le brainstorming, la rédaction technique et les cas d'usage métier via les GPTs personnalisés. Cette spécialisation réduit le temps perdu à reformuler des prompts et améliore la pertinence des résultats. Si vous souhaitez aller plus loin dans le choix de votre outil principal, le guide pratique pour choisir votre assistant IA pour coder détaille les critères de sélection selon votre contexte.

Accès API et automatisation

Les API des modèles 2026 ont gagné en maturité. Les patterns d'intégration courants incluent la génération automatique de changelogs, la revue de pull requests assistée, la détection de patterns problématiques dans le code et la génération de documentation technique. Le coût API reste un facteur déterminant. OpenAI et Anthropic facturent au token avec des tarifs qui varient selon le modèle et le niveau de raisonnement sollicité. Pour une équipe de dix développeurs, le budget mensuel peut varier de quelques centaines d'euros (autocomplétion seule) à plusieurs milliers (agents autonomes avec raisonnement avancé).

Besoin d'accompagnement sur votre projet ?

Parlons-enStratégie IA pour une équipe d'ingénierie

Au niveau architecte ou CTO, la question n'est plus "quel outil utiliser" mais "comment structurer l'adoption de l'IA dans l'organisation sans créer de dépendance ni de risque".

Build vs buy : le curseur s'est déplacé

En 2026, le curseur s'est déplacé en faveur de la consommation d'API pour la majorité des équipes. Les modèles propriétaires ont creusé l'écart sur le raisonnement complexe, et le coût de déploiement d'un modèle open source compétitif reste élevé. Le déploiement de Llama 4 ou Mistral Large 2 ne se justifie que dans deux cas : quand la souveraineté des données l'exige impérativement, ou quand le volume de requêtes rend le coût API prohibitif (au-delà de 10 000 requêtes par jour environ).

Souveraineté des données et conformité

C'est le point qui a le plus évolué depuis 2024. L'AI Act européen impose désormais des obligations de transparence sur l'utilisation de l'IA dans les produits. OpenAI, Anthropic et Google proposent des offres entreprise avec des garanties contractuelles renforcées sur le non-usage des données pour l'entraînement. Les options de déploiement on-premise ou VPC dédié se sont généralisées. DeepSeek, malgré ses performances, reste problématique pour les organisations européennes soumises à des contraintes réglementaires strictes en raison de son hébergement chinois. Un architecte doit cartographier les flux de données avant toute intégration et définir une politique claire sur ce qui peut ou non transiter par un service externe.

Évaluer un outil IA pour l'entreprise

Au-delà des benchmarks publics, l'évaluation d'un LLM pour un usage professionnel repose sur des critères rarement mentionnés dans les comparatifs grand public : la latence sous charge réelle, la stabilité de l'API sur plusieurs mois, la qualité du support entreprise, la roadmap du fournisseur, et la capacité du modèle à respecter des instructions complexes de manière consistante. Les benchmarks internes sur des cas d'usage métier restent la seule méthode fiable avant un déploiement à grande échelle.

Enjeux éthiques et responsabilité technique

Les IA génératives reproduisent et amplifient les biais présents dans leurs données d'entraînement. Les procès sur la propriété intellectuelle des données d'entraînement sont toujours en cours, avec des premières décisions contrastées aux États-Unis et en Europe. L'AI Act impose des obligations de transparence que les équipes techniques doivent intégrer dans leurs processus.

Pour un développeur senior, cela se traduit en pratiques concrètes : vérifier systématiquement le code généré avec des outils d'analyse statique comme PHPStan, ne pas déléguer la responsabilité architecturale à un modèle, et maintenir une expertise technique qui ne dépend pas de la disponibilité d'un service tiers. Pour un architecte, cela implique d'inscrire ces pratiques dans les standards de l'équipe et de prévoir des mécanismes de revue adaptés au code généré par IA.

Trajectoire et positionnement à moyen terme

La tendance de fond en 2026 est claire : les LLM deviennent des agents capables d'exécuter des tâches complètes plutôt que de simplement répondre à des questions. Claude Code, Copilot Agent, Cursor Composer : ces outils ne se contentent plus de suggérer du code, ils le modifient, le testent et l'itèrent. Cette évolution déplace la valeur ajoutée du développeur vers la conception, la revue critique et les décisions d'architecture, comme le choix entre architecture hexagonale et approches classiques.

La spécialisation continue de s'accélérer, et notre expertise en intelligence artificielle nous permet d'accompagner les équipes dans ces choix stratégiques. L'optimisation pour les moteurs IA devient un enjeu SEO majeur pour les entreprises qui veulent rester visibles dans les réponses générées par ces modèles. Des modèles plus petits et plus rapides, entraînés sur des domaines précis, deviennent viables pour le déploiement local. Cette évolution favorise les organisations qui auront structuré leur adoption autour de la composabilité : des interfaces d'intégration abstraites, des flux de données maîtrisés, et la capacité de remplacer un fournisseur par un autre sans réécrire l'infrastructure. L'architecte qui prépare son équipe à cette transition tirera le meilleur parti de chaque génération de modèles sans subir les ruptures.

Pour aller plus loin

- Symfony et IA : retour d'expérience sur un projet legacy, comment utiliser l'IA concrètement dans des projets Symfony

- RAG avec Symfony : indexer une base métier avec l'IA, mise en pratique de l'IA générative dans un contexte Symfony

- LLMs.txt : le nouveau levier SEO à l'ère de l'intelligence artificielle, rendre son application visible pour les IA génératives

- GEO : rendre votre application Symfony visible dans les moteurs IA, optimiser sa présence dans les réponses générées par les LLM

- PHPStorm, VS Code, Sublime Text : quel éditeur choisir ?, les outils de développement qui intègrent ces assistants IA

Intégrez l'IA dans votre projet

RAG, agents, visibilité dans les moteurs IA : nous aidons les équipes Symfony à tirer parti des nouvelles capacités de l'IA.

Discutons de votre projetArticles connexes

Comment monter en compétence sur Claude Code

CLAUDE.md, skills, hooks, serveurs MCP : les fonctionnalités clés de Claude Code et les bonnes pratiques pour devenir un utilisateur avancé.

Lire la suite →

Serveurs MCP et Claude Code : ce que ça change pour un développeur Symfony

Les serveurs MCP connectent Claude Code à vos bases de données, votre GitHub et vos outils de monitoring. Cas d'usage concrets pour un workflow Symfony.

Lire la suite →

10 skills Claude Code pour une équipe Symfony

Dix skills Claude Code prêts à l'emploi pour standardiser les pratiques d'une équipe Symfony : revue de code, tests, migrations, sécurité, refactoring et plus.

Lire la suite →